一、所选任务介绍

①本项目选择的任务为"语音点歌音乐盒",这是一个综合性的嵌入式系统设计项目,要求实现基于ESP32-S3微控制器的智能音乐播放系统。该系统需要集成多种传感器和执行器,包括蜂鸣器音频输出、RGB灯带视觉效果、语音识别控制、OLED显示以及旋转电位器音量调节等功能模块。任务的核心目标是通过语音指令和硬件交互实现对音乐播放的智能控制,同时配合灯光效果和实时显示,打造一个具有良好用户体验的交互式音乐播放设备。

②根据任务要求,系统需要预置至少3段旋律序列,使用蜂鸣器作为音频输出设备时必须配合RGB灯带实现音乐律动效果。语音识别功能需要支持播放、暂停、下一首、上一首、音量调节等至少5条指令,其中必须包含切换曲目的功能。OLED屏幕需要实时显示曲目编号、播放进度百分比和当前音量信息。本项目选择使用旋转电位器实现音量调节功能,通过物理交互提供更直观的用户体验。

二、项目介绍

①本项目最终实现了一个功能完善的语音控制音乐播放系统,成功集成了五大核心功能模块。系统预置了4首经典旋律,包括《小星星》(Twinkle Star)、《欢乐颂》(Ode to Joy)、《生日快乐歌》(Birthday)和《超级马里奥主题曲》(Mario)。这些旋律通过PWM控制的蜂鸣器进行播放,能够准确还原音符的音高和节奏。

②在视觉效果方面,系统使用RGB灯带实现了音乐律动功能,三个LED灯(绿色、黄色、红色)会随着音符的播放依次点亮,形成流水般的视觉效果,增强了音乐播放的观赏性。语音识别功能通过Python端的speech_recognition库实现,支持中文语音指令识别,用户可以通过"播放"、"暂停"、"下一首"、"上一首"、"音量大"、"音量小"等自然语言指令控制音乐播放器。

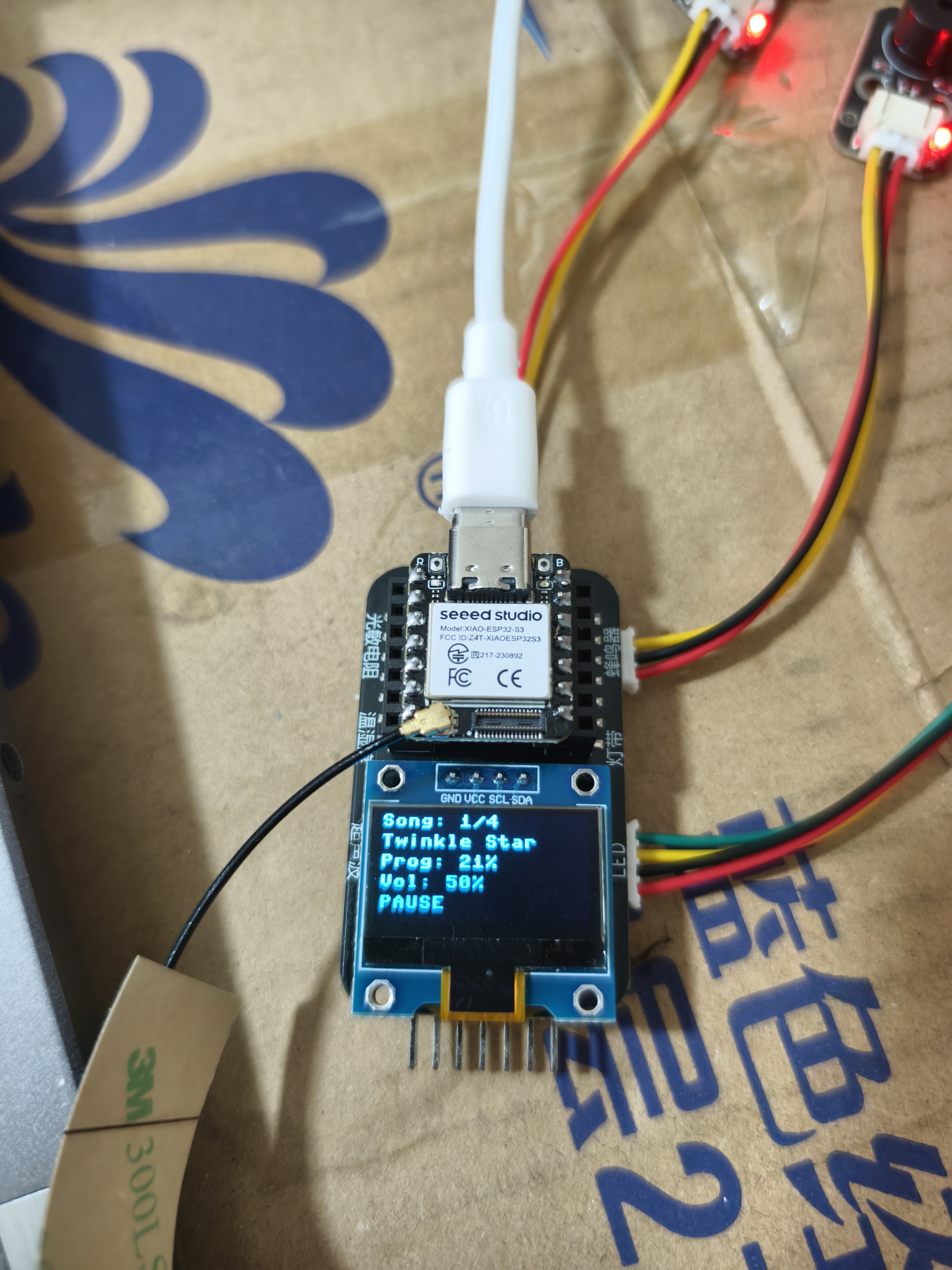

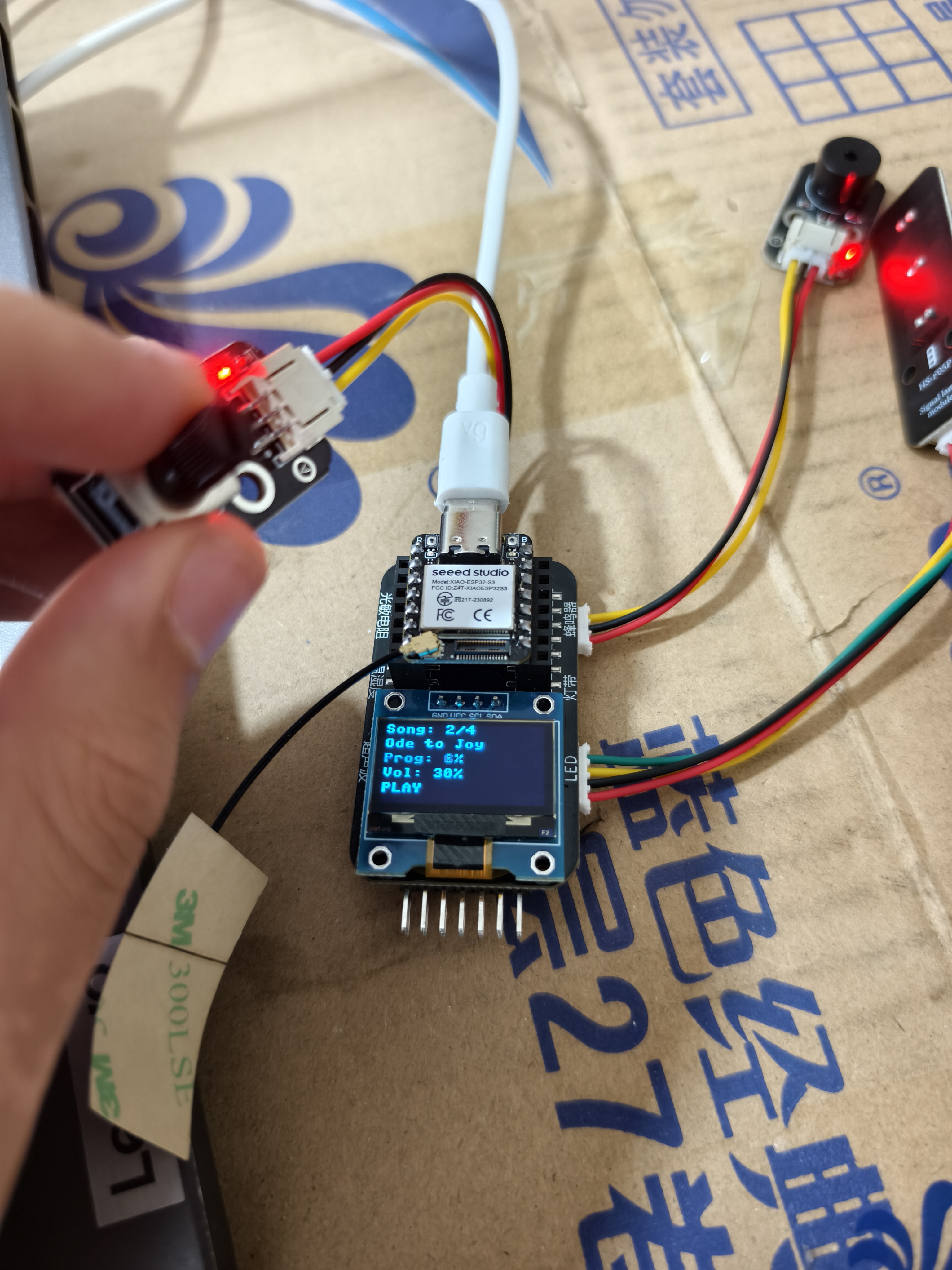

③OLED显示模块采用128×64分辨率的SSD1306显示屏,实时显示当前播放的曲目编号、曲目名称、播放进度百分比和音量百分比等信息,为用户提供直观的系统状态反馈。音量调节功能通过旋转电位器实现,系统设计了智能检测机制,只有当电位器被实际旋转时才会读取其数值更新音量,从而实现了电位器物理控制和语音控制的无缝切换。

④整个系统采用ESP32-S3微控制器作为核心处理单元,MicroPython作为嵌入式端编程语言,Python作为上位机语音识别处理语言,通过串口通信实现两端的指令交互。系统具有良好的实时响应性能,暂停指令可以在0.05秒内生效,语音识别到执行的延迟控制在1-3秒之间,为用户提供了流畅的交互体验。

三、硬件介绍

3.1 ESP32-S3 Sense开发板

ESP32-S3 Sense是本项目的核心控制器,这是一款由乐鑫科技推出的高性能双核处理器,基于RISC-V架构,主频高达240MHz。该开发板集成了丰富的外设接口,包括多路GPIO、PWM、I2C、ADC等,为项目提供了强大的硬件基础。开发板内置Wi-Fi和蓝牙模块,虽然本项目未使用无线通信功能,但为未来扩展远程控制功能预留了可能性。ESP32-S3支持MicroPython编程环境,这为快速开发和调试提供了便利。

3.2 蜂鸣器模块

蜂鸣器是系统的核心音频输出设备,本项目使用的是有源蜂鸣器,连接到ESP32的D10引脚(GPIO9)。通过PWM信号控制,蜂鸣器能够产生不同频率的音调,从而播放旋律。系统定义了从C4到E6的音符频率表,覆盖了两个八度的音域范围,能够满足大多数简单旋律的播放需求。蜂鸣器的音量通过PWM占空比进行调节,占空比范围为0-65535,与系统音量百分比(0-100%)进行线性映射。

3.3 RGB LED灯带

RGB LED灯带由三个独立的LED组成,分别为绿色LED(D6引脚,GPIO43)、黄色LED(D7引脚,GPIO44)和红色LED(D8引脚,GPIO7)。这些LED不是真正的RGB三色灯珠,而是三个独立的单色LED,通过依次点亮实现流水灯效果。在音乐播放过程中,每播放一个音符,LED会按照绿→黄→红的顺序循环点亮,形成视觉律动效果。LED采用数字IO控制,通过高电平点亮、低电平熄灭的方式进行控制。

3.4 OLED显示屏

OLED显示屏采用SSD1306驱动芯片,分辨率为128×64像素,通过I2C接口与ESP32通信。显示屏连接到D4(SDA,GPIO5)和D5(SCL,GPIO6)引脚。该显示屏具有自发光特性,对比度高,视角宽,功耗低,非常适合用于显示文本信息。系统使用ssd1306 MicroPython库进行驱动,能够显示英文字符和数字,用于呈现曲目信息、播放进度、音量等状态数据。

3.5 旋转电位器

旋转电位器是一个可变电阻器,通过旋转调节电阻值,从而改变输出电压。本项目将电位器的两端分别连接到3.3V和GND,中间的信号引脚连接到D0(GPIO1)的ADC输入端。ESP32的ADC具有12位分辨率,能够将0-3.3V的电压转换为0-4095的数字值。系统通过读取ADC值并映射到0-100的百分比范围,实现音量的连续调节。电位器提供了直观的物理交互方式,用户可以通过旋转获得即时的音量反馈。

四、方案框图和项目设计思路

4.1 系统架构设计

①本项目采用分布式处理架构,系统分为两个主要部分:嵌入式端(ESP32-S3)和上位机端(PC)。嵌入式端负责音乐播放控制、硬件驱动、显示更新等实时任务,上位机端负责语音识别和指令解析等计算密集型任务。两端通过USB串口进行通信,上位机将识别到的语音指令以文本形式(如"PLAY"、"NEXT"等)发送给嵌入式端,嵌入式端接收指令后执行相应的控制逻辑。

②这种架构的优势在于充分利用了各自的计算资源:PC端拥有强大的处理器和丰富的软件库,能够高效完成语音识别任务;ESP32端则专注于实时控制和硬件交互,确保音乐播放的流畅性和响应速度。同时,这种设计也为未来的功能扩展提供了灵活性,例如可以轻松替换不同的语音识别引擎或添加更多的控制指令。

4.2 核心设计思路

③系统的核心设计围绕"非阻塞式音乐播放"展开。传统的音乐播放器通常会在播放完整首歌曲后才能响应用户指令,这导致暂停等操作延迟严重。本项目创新性地采用了"逐音符播放"策略,将完整的旋律拆分为独立的音符单元,每播放完一个音符都会检查系统状态(是否暂停、音量是否变化等),这使得暂停指令能够在0.05秒内生效,大大提升了系统的响应性。

④在音量控制方面,系统面临电位器物理控制和语音控制的冲突问题。设计中采用了"变化检测"机制:系统持续读取电位器的ADC原始值,只有当数值变化超过设定阈值(100,约2.4%)时才认为用户在旋转电位器,此时才更新音量。如果电位器静止不动,系统就不读取其数值,从而允许语音指令修改音量。同时,每次语音调节音量后,系统会更新电位器的基准值,确保下次旋转时从当前音量开始调节,而不是跳回电位器物理位置对应的音量。

⑤灯光效果采用简单而有效的"循环点亮"策略,定义了一个状态变量(0、1、2),每播放一个音符后状态加1并取模,根据状态值点亮对应的LED。这种设计无需复杂的节拍分析或音强检测,就能实现基本的律动效果。

五、调试软件及编程语言说明

5.1 开发环境与编程语言

本项目采用双语言开发模式。嵌入式端使用MicroPython作为编程语言,这是Python 3的精简实现,专为微控制器设计。MicroPython保留了Python简洁的语法和丰富的标准库,同时针对嵌入式环境进行了优化,具有较小的内存占用和良好的实时性能。开发工具使用Thonny IDE,这是一款专为Python初学者设计的集成开发环境,内置了对MicroPython的完整支持,可以直接连接ESP32进行代码上传、运行和调试。

上位机端使用标准Python 3编写,利用vosk中文模型实现语音识别功能,使用pyserial库进行串口通信。开发环境可以是任意Python IDE或文本编辑器配合命令行工具。选择Python的原因是其拥有丰富的第三方库生态,语音识别、音频处理、串口通信等功能都有成熟的库支持,能够快速实现原型开发。

5.2 主要使用的库

嵌入式端主要使用的MicroPython库包括:

- machine库:提供Pin、PWM、I2C、ADC等硬件接口控制

- ssd1306库:OLED显示屏驱动库

- time库:时间延时和计时功能

- sys和select库:用于非阻塞串口读取

上位机端主要使用的Python库包括:

- vosk:语音识别核心库

- pyserial:串口通信库

- pyaudio:音频流处理库,为语音识别提供麦克风输入

5.3 软件流程图

嵌入式端的主程序流程采用单循环架构,主循环不断执行以下步骤:

- 检查串口是否有数据到达,如果有则读取指令并执行对应的控制函数(播放、暂停、切歌、音量调节等)

- 调用电位器检测函数,判断电位器是否被旋转,如果检测到旋转则更新音量

- 如果当前处于播放状态,调用播放下一个音符的函数

- 定期更新OLED显示内容(每200ms刷新一次)

- 如果不在播放状态,进行短暂延时(20ms)以降低CPU占用

音符播放函数采用分段延时策略,将音符时长切分为多个50ms的片段,每个片段后都检查播放状态,如果检测到暂停标志则立即停止蜂鸣器并返回,这是实现快速响应的关键。

上位机端的流程相对简单:

- 初始化语音识别器和麦克风

- 打开串口连接

- 进入监听循环

- 等待用户说话,使用Google API识别语音内容

- 在识别结果中查找关键词(如"播放"、"暂停"等)

- 找到匹配关键词后,将对应的指令通过串口发送给ESP32

- 读取ESP32返回的确认信息并显示

5.4 关键代码介绍

5.4.1 智能电位器检测代码

这是本项目最核心的创新点之一,解决了电位器物理控制与语音控制的冲突问题:

def check_and_read_pot(self):

"""检测电位器是否被旋转,只有真正旋转时才更新音量"""

current_pot_raw = potentiometer.read() # 读取当前ADC值(0-4095)

raw_diff = abs(current_pot_raw - self.last_pot_raw_value) # 计算变化量

if raw_diff > self.pot_threshold: # 变化超过阈值(100)才认为是旋转

new_volume = int((current_pot_raw / 4095) * 100) # 映射到0-100

self.volume = new_volume

self.last_pot_raw_value = current_pot_raw # 更新基准值

print(f"🎛 电位器调节: {self.volume}%")

return True

return False # 电位器未动,不更新音量

这段代码的核心思想是"变化检测"而非"值读取"。系统不是每次都盲目读取电位器值并更新音量,而是先判断电位器是否真的被旋转了。通过比较当前ADC值与上次记录的值,只有变化超过100(约2.4%)才认为是有效旋转。这个阈值的设定既能过滤ADC读数的随机噪声,又能捕捉用户的真实操作意图。

5.4.2 非阻塞音符播放代码

这是实现快速暂停响应的关键:

def play_note(self, note, duration):

"""播放单个音符(支持中断)"""

freq = TONES.get(note, 0)

duty = int(self.volume * 655.35) if freq > 0 else 0

if freq > 0:

buzzer.freq(freq) # 设置频率

buzzer.duty_u16(duty) # 设置占空比(音量)

self.set_led(self.led_state) # 点亮对应LED

self.led_state = (self.led_state + 1) % 3 # 循环切换LED

# 关键:分段延时,每0.05秒检查一次状态

elapsed = 0

step = 0.05

while elapsed < duration:

if not self.is_playing: # 检测到暂停

buzzer.duty_u16(0) # 立即停止

return False # 返回中断标志

time.sleep(step)

elapsed += step

buzzer.duty_u16(0)

return True # 播放完成

传统的延时方式是使用time.sleep(duration)一次性等待整个音符时长,这会导致暂停指令必须等到音符播放完才能响应。本代码将时长切分为多个50ms的小片段,每个片段后都检查is_playing标志,一旦检测到暂停就立即停止蜂鸣器并返回,将响应延迟从可能的数秒降低到50ms以内。

5.4.3 语音控制音量代码

语音调节音量时需要同步更新电位器基准值:

def volume_up(self):

"""音量增加(语音控制)"""

self.volume = min(100, self.volume + 10) # 增加10%,不超过100%

self.last_pot_raw_value = potentiometer.read() # 关键:更新基准值

self.update_display()

print(f"🔊 语音控制: {self.volume}%")

return f"Volume: {self.volume}%"

这里的关键在于self.last_pot_raw_value = potentiometer.read()这一行。假设电位器当前在50%位置(ADC约2048),语音指令将音量调到60%,但电位器物理位置没变。如果不更新基准值,下次电位器检测时会发现ADC仍是2048(对应50%),系统会误判为用户将音量调回50%。通过更新基准值,告诉系统"电位器虽然在50%位置,但当前音量是60%",下次旋转时就会从60%开始调节。

5.4.4 上位机语音识别关键代码

# 关键词映射表

KEYWORD_MAP = {

'播放': 'PLAY', '开始': 'PLAY', '继续': 'PLAY',

'暂停': 'PAUSE', '停': 'PAUSE',

'下一首': 'NEXT', '下': 'NEXT', '换': 'NEXT',

'上一首': 'PREV', '上': 'PREV',

'大': 'VOLUP', '音量大': 'VOLUP',

'小': 'VOLDOWN', '音量小': 'VOLDOWN',

}

# 主循环

while True:

with mic as source:

audio = recognizer.listen(source, timeout=1.5, phrase_time_limit=1.5)

text = recognizer.recognize_google(audio, language='zh-CN')

# 在识别结果中查找关键词

for keyword, command in KEYWORD_MAP.items():

if keyword in text:

ser.write((command + '\n').encode()) # 发送指令

break

这段代码实现了灵活的中文语音识别。通过维护一个关键词映射表,系统可以识别多种表达同一意图的说法(如"播放"、"开始"、"继续"都映射到PLAY指令)。识别采用Google Web Speech API,支持中文语境下的连续语音识别,识别成功后通过串口发送标准化的英文指令给ESP32。

六、功能展示及说明

6.1 音乐播放功能

系统预置了4首经典旋律,每首歌曲以音符序列的形式存储在代码中。旋律数据结构为(音符, 时长)的元组列表,例如('C5', 0.5)表示播放中央C音(C5,523Hz)持续0.5秒。播放时,系统通过PWM控制蜂鸣器频率产生对应音高,通过占空比控制音量大小。

《小星星》包含28个音符,播放时长约30秒;《欢乐颂》包含32个音符,时长约25秒;《生日快乐歌》包含24个音符,时长约20秒;《超级马里奥主题曲》包含22个音符,时长约15秒。系统支持循环播放,歌曲播放完毕后会自动停止,用户可通过语音或再次点击播放按钮重新开始。

播放过程中,OLED屏幕实时显示播放进度百分比,计算方式为(当前音符索引 / 总音符数) × 100%。进度条采用数字百分比形式显示,每播放完一个音符就更新一次,让用户清楚了解播放进度。

6.2 LED灯光律动效果

三个LED灯在音乐播放时实现循环点亮效果。系统维护一个状态变量led_state,初始值为0。每播放一个音符后,根据当前状态值点亮对应的LED(0=绿色,1=黄色,2=红色),然后状态值加1并对3取模,实现循环。

具体效果为:音符1播放时绿灯亮,音符2播放时黄灯亮,音符3播放时红灯亮,音符4播放时又回到绿灯,如此循环。这种设计虽然简单,但能有效配合音乐节奏产生视觉律动感。当播放休止符(音符为'0')时,所有LED熄灭,营造出音乐的韵律感。

在暂停或停止播放时,系统会强制关闭所有LED,避免灯光残留影响视觉体验。LED采用数字IO控制,高电平点亮、低电平熄灭,响应速度快,与音符播放完全同步。

6.3 语音识别控制功能

系统支持6种中文语音指令,实现了全语音操控:

- 播放指令:识别"播放"、"开始"、"继续"等关键词,启动音乐播放或从暂停处继续

- 暂停指令:识别"暂停"、"停"等关键词,立即停止音乐播放(50ms内响应)

- 下一首指令:识别"下一首"、"下"、"换"等关键词,切换到下一首歌曲

- 上一首指令:识别"上一首"、"上"、"返回"等关键词,切换到上一首歌曲

- 音量增大指令:识别"音量大"、"大声"、"大"等关键词,音量增加10%

- 音量减小指令:识别"音量小"、"小声"、"小"等关键词,音量减少10%

语音识别过程为:用户对着PC麦克风说话→vosk库捕获音频→调用vosk中文模型识别→在结果中查找关键词→匹配成功后通过串口发送指令→ESP32接收并执行。整个过程延迟通常在1-3秒之间,取决于网络状况和语音清晰度。

系统采用了关键词容错设计,例如说"下一首歌"、"播放下一首"、"换一首"都能被识别为NEXT指令,提高了语音识别的实用性和用户体验。

6.4 OLED显示功能

OLED显示屏采用5行文本布局,每行显示不同的系统信息:

- 第1行:Song: X/4 - 显示当前歌曲编号和总歌曲数

- 第2行:歌曲名称(最多16个字符)

- 第3行:Prog: XX% - 显示播放进度百分比

- 第4行:Vol: XX% - 显示当前音量百分比

- 第5行:PLAY或PAUSE - 显示当前播放状态

显示内容每200ms刷新一次,确保信息实时准确。在播放过程中,进度百分比会平滑增长;旋转电位器时,音量百分比会实时跟随;切换歌曲时,歌曲编号和名称会立即更新。显示屏采用白色字符配黑色背景,对比度高,即使在强光下也清晰可见。

6.5 旋转电位器音量调节功能

旋转电位器提供了0-100%的连续音量调节能力。用户顺时针旋转电位器,音量逐渐增大;逆时针旋转,音量逐渐减小。系统实时读取电位器的ADC值(0-4095),线性映射到音量百分比(0-100%),然后通过PWM占空比控制蜂鸣器音量。

电位器调节的优势在于提供了即时的触觉反馈和精确的控制粒度。与语音控制的10%步进相比,电位器可以实现1%甚至更精细的调节。系统采用智能检测机制,只有当电位器ADC值变化超过100(约2.4%)时才认为是有效旋转,过滤了ADC读数的随机噪声,同时保证了对真实操作的灵敏响应。

电位器与语音控制可以无缝切换:当用户语音调节音量后,只要不旋转电位器,音量就保持在语音设定值;一旦开始旋转电位器,系统立即切换到电位器控制模式。这种设计充分利用了两种交互方式的优势:语音控制适合快速调节和远距离操作,电位器控制适合精细调节和即时反馈。

6.6 功能联动演示

系统各功能模块能够协同工作,实现流畅的用户体验。典型使用场景如下:

- 启动播放:用户说"播放"→PC识别后发送PLAY指令→ESP32开始播放第1首歌→OLED显示"Song: 1/4 Twinkle Star"→蜂鸣器开始发声→LED灯开始绿黄红循环闪烁→进度从0%开始增长

- 音量调节:播放过程中用户说"音量大"→音量从50%增加到60%→OLED显示"Vol: 60%"→蜂鸣器音量立即增大→LED亮度保持不变→用户旋转电位器→OLED显示"Vol: 75%"→音量随之变化

- 切换歌曲:用户说"下一首"→当前歌曲立即停止→LED全部熄灭→歌曲编号从1变为2→OLED显示"Song: 2/4 Ode to Joy"→进度重置为0%→等待用户发出播放指令

- 暂停与继续:播放中用户说"暂停"→蜂鸣器在50ms内停止→LED全部熄灭→OLED显示"PAUSE"→进度保持在当前值(如37%)→用户说"播放"→从37%处继续播放→LED恢复律动

七、项目中遇到的难题及解决方法

7.1 音乐播放响应延迟问题

问题描述:项目初期采用传统的音乐播放方式,即每个音符使用一次完整的time.sleep(duration)延时。这导致在播放长音符(如1秒以上)时,暂停指令必须等到该音符播放完毕才能生效,延迟可能长达数秒,严重影响用户体验。特别是在《欢乐颂》等歌曲中,部分音符时长达到0.8-1.6秒,暂停响应非常迟钝。

解决过程:最初尝试使用中断机制,但MicroPython的中断处理较为复杂且不够稳定。后来参考音频流处理的思想,将音符播放改为分段延时策略。将每个音符的时长切分为多个50ms的小片段,每个片段后检查播放状态标志。如果检测到暂停(is_playing = False),立即停止蜂鸣器并返回False,外层函数收到False后不再播放后续音符。

最终效果:暂停响应时间从最长数秒降低到最多50ms,用户感觉上几乎是即时响应。这个改进大大提升了系统的交互体验,使得音乐播放器的控制更加流畅自然。

7.2 电位器与语音控制的冲突问题

问题描述:这是项目中最复杂的技术难题。系统主循环每轮都会读取电位器数值并更新音量,而语音控制也会修改音量。当用户通过语音将音量调到60%后,电位器物理位置可能还停留在50%,主循环下一次读取电位器时就会将音量覆盖回50%,导致语音控制失效。这个问题持续困扰了很长时间,几乎无法实现两种控制方式的兼容。

尝试的方案:

- 延迟读取方案:语音控制后3秒内不读取电位器。这种方法部分有效,但如果用户在3秒内想用电位器调节就无法响应,用户体验差。

- 模式切换方案:设置AUTO/POT/VOICE三种模式,需要用户手动切换。这增加了操作复杂度,不符合设计初衷。

最终解决方案:采用"变化检测"而非"值读取"的思路。系统记录电位器上次的ADC原始值,每次检测时计算当前值与上次值的差值,只有差值超过阈值(100,约2.4%)才认为电位器被旋转,此时才更新音量。关键创新点是:语音调节音量后,立即读取并更新电位器的基准值,这样即使电位器物理位置没变,系统也知道当前音量已经改变,不会误判为用户操作。

技术细节:阈值设定为100(12位ADC的2.4%)是经过反复测试确定的,既能过滤ADC读数的±10左右的随机噪声,又能敏感捕捉用户的真实旋转操作。这个方案巧妙地解决了物理控制与数字控制的冲突,是项目最大的技术亮点之一。

八、心得体会

8.1 技术层面的收获

通过这个项目,我深刻体会到嵌入式系统开发与传统软件开发的本质区别。在PC端编程时,我们可以调用丰富的库、使用大量内存、依赖操作系统的多线程调度。但在ESP32这样的微控制器上,每一行代码都要考虑资源消耗,每一个延时都可能影响系统响应性。这种约束反而激发了创造性思维,促使我寻找更优雅的解决方案。

MicroPython作为开发语言,在保留Python简洁性的同时,也让我意识到高级语言在嵌入式领域的局限性。例如垃圾回收机制可能导致不可预测的延迟,动态类型检查会增加运行时开销。但权衡利弊后,MicroPython仍是快速原型开发的绝佳选择,特别是对于硬件接口丰富、逻辑较为复杂的项目。

硬件调试是另一个重要的学习领域。从最初的接线错误导致的无法启动,到PWM频率设置不当引起的异常噪音,每一个问题都需要结合示波器观察、串口日志分析、甚至手动测量电压来定位。这培养了我系统化排查问题的能力和耐心细致的工作态度。

8.2 系统设计的思考

项目最初的设计相对简单:读取指令→执行动作→更新显示。但在实际开发中发现,各个模块之间存在复杂的交互关系,简单的顺序执行无法满足需求。电位器读取与语音控制的冲突、音乐播放的实时性要求、显示刷新的性能优化等问题,让我认识到系统架构设计的重要性。

采用分布式架构(PC端负责语音识别,ESP32端负责实时控制)是一个关键决策。虽然这增加了两端通信的复杂度,但充分利用了各自的计算资源优势。PC端强大的处理能力可以运行成熟的语音识别引擎,ESP32则专注于硬件实时控制。这种设计也体现了"合适的任务放在合适的平台"的工程思想。

状态管理是另一个深刻的体会。系统需要维护多个状态变量:当前歌曲、播放状态、音量、LED状态、电位器基准值等。如何确保这些状态的一致性和同步更新,如何避免状态冲突,都需要仔细设计。最终采用的MusicPlayer类封装方案,将所有状态和操作封装在一起,既提高了代码可读性,也降低了状态管理的复杂度。

8.3 问题解决的方法论

项目中遇到的每个难题,都经历了"问题定义→方案探索→实验验证→迭代优化"的过程。这让我深刻认识到,工程问题往往没有唯一的最优解,只有在特定约束条件下的合理方案。

以电位器冲突问题为例,我尝试了延迟读取、模式切换、阈值检测等多种方案,每种方案都有优缺点。最终选择的变化检测方案,是在用户体验、系统复杂度、响应速度之间找到的平衡点。这个过程教会我:不要局限于第一个想到的解决方案,多角度思考往往能找到更好的方法。

日志调试在问题定位中起到了关键作用。通过在关键节点添加print()语句,我能够清楚地看到程序的执行流程、变量的实时值、异常的发生位置。这种看似"原始"的调试方法,在嵌入式开发中往往比复杂的调试器更加实用和直观。

8.4 团队协作与文档的重要性

虽然这是个人项目,但在开发过程中我深刻体会到代码可读性和文档的重要性。当项目代码超过500行时,如果没有清晰的注释和结构,即使是自己写的代码,过几天再看也会感到陌生。因此我养成了良好的编码习惯:每个函数都有详细的文档字符串,关键逻辑都有行内注释,复杂算法都有原理说明。

项目目录结构的组织也很重要。将ESP32端代码(main.py)和PC端代码(voice_control.py)分离,配置参数集中定义,使得项目易于维护和扩展。这种规范化的项目管理,为未来可能的功能扩展(如添加新歌曲、集成新的控制方式)打下了良好基础。

8.5 用户体验设计的感悟

技术实现是基础,但用户体验才是产品的灵魂。在开发过程中,我不断站在用户角度思考:暂停响应是否够快?音量调节是否顺滑?语音识别是否准确?这些看似微小的细节,实际上决定了系统的可用性。

50ms的暂停响应时间、2.4%的电位器检测阈值、200ms的显示刷新间隔,这些参数都是经过反复测试和调整得出的。过快的响应可能导致误操作,过慢则影响体验;阈值过小会被噪声干扰,过大则反应迟钝。工程设计就是在这些矛盾中寻找平衡点的过程。

语音识别的关键词映射策略也体现了用户中心的设计思想。用户不会记住标准化的指令词,他们会用自然语言表达意图。通过支持多种表达方式,系统变得更加智能和人性化。

8.6 项目管理与时间规划

项目从构思到完成历时约两周,中间经历了多次推倒重来和方案调整。这让我认识到,在开始编码之前做好充分的需求分析和技术预研是多么重要。最初没有充分考虑电位器冲突问题,导致后期花费大量时间重构代码。

分阶段推进的策略被证明是有效的:先实现基本的音乐播放功能,再添加LED灯光,然后集成OLED显示,最后处理电位器和语音控制。每完成一个阶段都进行充分测试,确保功能稳定后再推进下一步。这种渐进式开发方法,避免了因一次性集成所有功能而导致的调试困难。

版本控制的缺失是一个遗憾。项目过程中多次因为修改导致原本正常的功能失效,而没有版本备份就只能重新调试。这个教训让我认识到,即使是小型项目,也应该使用Git等版本控制工具,记录每一次重要的修改。

8.7 未来改进方向的思考

虽然项目实现了所有核心功能,但仍有很多改进空间:

- 扬声器替代蜂鸣器:使用DAC输出真实的音频波形,配合功放和扬声器,可以大幅提升音质,甚至支持播放MP3等数字音频。

- 离线语音识别:使用EDGE IMPULSE训练关键词识别模型,部署到ESP32上,实现完全离线的语音控制,消除网络延迟。

- 动态乐谱加载:将歌曲存储在SD卡或闪存中,支持用户自定义添加新曲目,而不是硬编码在程序里。

- 更丰富的灯光效果:使用可编程RGB LED(如WS2812B),根据音频频谱分析实现更复杂的灯光律动效果。

- 物联网功能:利用ESP32的Wi-Fi功能,开发网页或小程序远程控制界面,实现远程选曲和音量调节。

这些改进方向既是技术挑战,也是学习机会,为未来的深入研究指明了方向。

8.8 总结与展望

这个项目让我完整地经历了嵌入式系统开发的全过程,从需求分析、硬件选型、系统设计、编码实现到调试优化。每一个环节都充满挑战,也都带来成长。技术层面掌握了MicroPython开发、PWM控制、ADC采集、I2C通信等嵌入式核心技能;工程层面学会了系统架构设计、状态管理、性能优化等实用方法;素养层面培养了问题分析能力、文档编写习惯、用户体验意识。

最重要的是,这个项目让我真切体会到,工程不仅仅是技术的堆砌,更是艺术和科学的结合。如何在有限的资源下实现最优的性能,如何在复杂的约束中找到创造性的解决方案,如何让冰冷的硬件具有温度和情感,这些都是工程师需要终身学习的课题。

展望未来,我希望能够继续深入嵌入式和物联网领域,探索更多有趣的应用场景。也许下一个项目是智能家居控制系统,也许是机器人导航算法,也许是可穿戴健康监测设备。无论是什么,我都将带着这个项目中积累的经验和教训,不断挑战自己,创造有价值的作品。